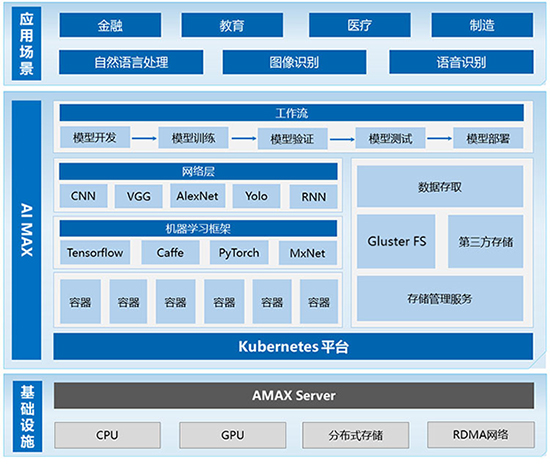

AI MAX-概述

AI Max 是 AMAX一款基于 Kubernetes+Docker+GPU 架构,定位于机器学习的上层应用,免去客户编写代码的麻烦,快速开始深度学习任务的平台。软件基于容器基础,内置多种深度学习框架,兼具细粒度的权限管控,完善的数据与镜像的存储、隔离,提供多种交互式开发及 API 接口,可满足多用户、多场景的需求。

核心技术架构

- 基础层:基础设施以硬件服务器为载体,支持主流 X86 服务器,配置 NVIDIA GPU 实现高性能加速计算

- 采用主流分布式存储设备(如:XP-42305ST),支持 TCP/IP,InfiniBand 高速网络互联

- 平台层:包含操作系统、GPU 驱动、CUDA、CuDNN、机器学习框架

- 完整的机器学习所需的处理流程,实现资源操作自动化,并向用户提供应用交付服务

- 基于 Kubernetes+Docker+GPU 架构,容器化部署

平台特性

- 内置多种深度学习框架(Caffe、TensorFlow、MxNET、Pytorch等)

- 细粒度的权限管控,支持多用户、多场景

- 完善的数据与镜像的存储、隔离机制

- 提供多种交互式开发方式(Jupyter、JupyterLab、PyCharm、Terminal)

- 支持 API 接口,便于集成和扩展

AI MAX-核心功能

直观的工作界面

表盘式工作界面,从首页可以看到集群所有资源、已分配的资源、计算节点信息、任务信息等。菜单界面平滑直观,所有功能一目了然,功能化繁为简。用户界面清晰展示所有项目,管理员界面可灵活支配计算机资源并完整记录用户详细信息。

细粒度权限管理

管理员可通过用户管理对用户进行细粒度管理,支持对用户或用户组进行增删改查等操作。可根据不同场景、应用需求设置不同的用户权限,达到细致的安全控制。完善的权限控制体系确保数据安全和系统稳定。

强大的镜像管理

系统预置种类丰富的任务镜像,支持各种机器学习框架。用户可通过基础镜像与 Docker exec console 制作镜像保存到镜像仓库,公共镜像和私人镜像相互隔离。支持自定义资源配额(CPU、内存、GPU 等)和自定义 python package,可支持本地环境 pull 和 push 镜像。

分布式数据存储

基于 Gluster 的分布式存储架构,存储容量大、容易横向扩展。各用户自动创建指定配额的存储用于存放训练数据集、测试数据集、训练结果等。支持创建私有数据、数据共享、取消共享。分布式存储网络支持 IB 和 RDMA,保证大规模网络训练时的网络带宽。

高效的模型训练

基于 Kubernetes 的容器调度引擎,支持离线训练和多机多卡分布式训练。支持可视化显示 loss 和 accuracy 变化曲线,实时查看任务训练 log 输出。可动态调度任务到优质节点,保证资源使用效率。通过资源配额、任务调度和容错,使模型训练任务高效可靠。

完善的集群管理

支持集群节点添加、删除、资源使用监控、远程开关机、健康状态监控。具备节点远程控制台,用户可监控机器健康状态和资源使用情况。使用直方图显示节点和分区 CPU、GPU、Mem、网络IO、运行容器数量的实时统计,可显示任务 GPU 显存使用率。

简化的部署流程

支持多种深度学习框架,利用容器技术将大量底层操作进行封装,极大简化深度学习操作流程,大大降低技术门槛。整合计算、存储和网络资源,优化挖掘硬件存储能力,免去传统集群环境下存储的规划、连接、配置等复杂管理操作。

灵活的扩展能力

客户可通过 AI Max 灵活高效地实现节点拓展,增加资源以满足业务增长。弹性伸缩的架构设计,让用户更聚焦业务本身,加速 AI 业务快速开发和上线。适用于图像处理、语音识别、自然语言处理等多种深度学习场景。